ChatGPT connaît votre type de personnalité MBTI

Et si votre manière de poser des questions à une IA trahissait votre fonctionnement mental profond ? Certains utilisateurs affirment que ChatGPT devine avec précision leur type MBTI. Mais est-ce vraiment crédible ?

C’est quoi le MBTI ?

Le MBTI (Myers-Briggs Type Indicator) est un test de personnalité basé sur quatre axes binaires : Introversion/Extraversion, Intuition/Sensation, Pensée/Sentiment, Jugement/Perception. Il en résulte 16 profils comme INTJ, ENFP, ou ISTP. Bien que controversé dans les milieux scientifiques, ce test est très populaire, notamment dans les domaines du développement personnel ou du management. Vous pouvez découvrir votre profil facilement et gratuitement sur le site officiel du MBTI.

Peut-on vraiment détecter un type MBTI à l’écrit ?

Théoriquement, oui. La façon dont vous formulez vos idées, structurez vos demandes, ou priorisez certaines logiques, peut refléter un style cognitif cohérent avec un profil MBTI. Les IA comme ChatGPT sont conçues pour détecter des schémas linguistiques et pourraient en effet établir des hypothèses à partir d’un grand volume d’échanges.

Faites le test ! Ouvrez une nouvelle conversation avec votre assistant préféré et demandez lui :En te basant sur nos échanges, selon toi quel type MBTI me correspond le mieux ? Et pourquoi ?

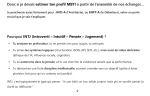

Personnellement, j'ai fais l'expérience, voici sa réponse :

Quand l’analyse de ChatGPT devient pertinente

Plus l’usage que vous faites de ChatGPT est spontané, varié et personnel, plus l’analyse a des chances d’être pertinente. Une conversation naturelle où vous exprimez vos opinions, racontez des expériences ou développez une réflexion permet à l’IA de cerner votre structure cognitive.

En revanche, un usage purement professionnel ou technique limite fortement la portée de cette lecture de personnalité.

Conclusion : un miroir imparfait mais utile

Demander à ChatGPT de deviner votre type MBTI peut être un exercice stimulant. Ce n’est pas une vérité psychologique, mais un point de départ pour mieux comprendre votre style de pensée. Comme tout outil d’introspection, il vaut ce que vous y mettez — mais peut parfois surprendre par sa justesse.

Comment ChatGPT peut-il détecter des traits de personnalité MBTI dans mes messages ?

L’IA repère des schémas de langage : structure logique ou intuitive, ton analytique ou expressif, manière de poser les questions. Ces éléments peuvent correspondre à certains profils MBTI.

Dans quels cas ChatGPT peut-il donner un résultat MBTI pertinent ?

Lorsque l’utilisateur discute avec l’IA de façon naturelle, en exprimant librement ses idées. Les usages trop techniques ou professionnels faussent l’analyse.

Faut-il se fier à l’analyse de ChatGPT pour connaître son type MBTI ?

Non. ChatGPT peut donner une piste, mais cela ne remplace pas un test validé. Pour un résultat fiable, mieux vaut utiliser une plateforme certifiée on en parler avec son psychologue.