Quelle est la place de l'IA dans les municipales de 2026 en France ?

Les élections municipales de 2026 marquent un tournant discret mais significatif dans la communication politique. Loin des grandes agences de pub traditionnelles, de nombreux candidats, petites et grandes listes confondues, intègrent désormais l'intelligence artificielle générative dans leur arsenal. Que ce soit pour concevoir des affiches à moindre coût, animer des meetings virtuels ou répondre aux électeurs via des chatbots, la technologie s'installe comme un outil de terrain. Cet article décrypte comment l'IA prend place dans la démocratie locale, ce que la loi autorise réellement, et pourquoi la transparence devient le nouveau enjeu de ces campagnes.

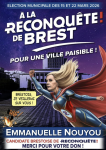

De l’affiche papier au concept art politique

L'utilisation la plus visible concerne la génération d'images. Pour un candidat local, commander une affiche chez un graphiste représente un coût non négligeable. L'IA permet de produire en quelques secondes des visuels aux couleurs de la ville, souvent avec un rendu artistique ou peint qui se détache du style photographique classique.

C'est le cas à Grenoble, où le candidat Horizons Hervé Gerbi a utilisé une image entièrement synthétique pour illustrer sa vision de la ville, y ajoutant explicitement la mention "Image générée par IA". Cette approche permet aussi de visualiser des projets qui n'existent pas encore : une place piétonne, un nouveau tramway ou une façade rénovée. On passe ici du simple photomontage à la création de scènes oniriques, un peu comme les concept artists dans le jeu vidéo prévisualisent un monde avant sa création.

Mais cette créativité débridée a ses limites. Un rendu imparfait — une main maladroite, une perspective incohérente ou un effet "peau plastique" — peut vite virer au désastre communicationnel. Sur les réseaux sociaux, une affiche "ratée" devient instantanément un sujet de moquerie, transformant un candidat moderne en objet de ridicule. La technique doit rester invisible : si l'électeur perçoit l'artifice avant le message, l'effet recherché s'effondre.

L’IA au service de l’interactivité et du coût

Au-delà de l'image, l'IA change la nature de la rencontre avec l'électeur. Là où un candidat ne peut être physiquement présent partout, les agents conversationnels prennent le relais. Entraînés sur le programme officiel d'une liste, ces chatbots peuvent répondre 24h/24 aux questions précises sur le budget municipal, l'urbanisme ou la culture. C’est une économie d'échelle drastique pour des équipes de campagne souvent réduites. Cependant, cette automatisation n'est pas sans risque : une hallucination de l'IA — une réponse inventée ou inexacte sur un chiffre du budget — pourrait se transformer en bad buzz politique si elle n'est pas supervisée par un humain.

La frontière ténue entre promotion et deepfake

Si l'affiche artistique est généralement acceptée, l'usage de l'IA pour déformer le réel soulève des questions éthiques majeures. Nous avons vu fleurir des exemples de vidéos ou d'images truquées diffusées sur les réseaux sociaux pour discréditer un adversaire ou dramatiser une situation (comme la saleté d'une rue).

Lorsque l'IA est utilisée pour créer une fausse réalité — montrer un candidat tenant la main de son rival ou prononçant des mots qu'il n'a jamais dits — on entre dans le domaine du deepfake. C'est ici que le bât blesse. Techniquement, il est facile pour un développeur ou un artiste numérique de générer ces contenus, mais juridiquement, cela s'apparente à de la désinformation électorale.

Que dit la loi française à ce sujet ?

Pour l'heure, le cadre juridique est en rattrapage technologique. Rien n'interdit formellement l'utilisation d'outils comme Midjourney ou DALL-E pour créer du contenu de campagne, à condition de respecter les règles générales de la propagande électorale. La CNIL et l'ARCOM veillent particulièrement au grain. L'Europe, via l'AI Act, impose une obligation de transparence : si un contenu est généré par IA, cela doit être indiqué clairement. L'objectif est d'éviter que l'électeur ne soit trompé sur la nature de ce qu'il voit. En cas de deepfake malveillant, des sanctions peuvent être prononcées pour atteinte à la vie privée ou diffusion de fausses nouvelles de nature à altérer la sincérité du scrutin.

Vers une démocratie augmentée ou synthétique ?

L'irruption de l'IA dans les municipales 2026 n'est pas un épiphénomène. Elle traduit une mutation de notre rapport à l'image et à l'information. Pour les candidats, c'est un levier de modernité et d'efficacité. Pour les citoyens, cela demande une nouvelle forme de littératie numérique : être capable de distinguer le vrai du faux, le réel du synthétique. À mesure que les outils se démocratisent, la campagne électorale risque de ressembler à un mélange entre un jeu vidéo et un débat politique, où la frontière entre le projet concret et la promesse virtuelle deviendra de plus en plus floue.

Sources

- Municipales : l'IA s'invite dans la campagne – Franceinfo : Reportage sur l'usage de l'IA par des candidats comme Hervé Gerbi à Grenoble.

- Municipales 2026 : l'IA est omniprésente dans la campagne – 20 Minutes : Analyse des dérives et des usages variés de l'IA générative (chatbots, vidéos).

- Les images créées par l'IA s'invitent dans la campagne – Banque des Territoires : Point sur les enjeux juridiques et les risques de manipulation de l'information.

Est-il légal d'utiliser l'IA pour une affiche électorale en France ?

Oui, c'est légal tant que le contenu respecte le code électoral. L'AI Act européen impose cependant d'indiquer clairement que l'image est générée par IA.

Quels sont les risques des deepfakes pour les élections municipales ?

Le risque principal est la diffusion de fausses informations pouvant nuire à la réputation d'un candidat ou tromper les électeurs sur un programme, ce qui peut constituer un délit.

Comment savoir si une vidéo politique est truquée ?

Repérez les incohérences visuelles, les mouvements oculaires anormaux ou vérifiez la source. En France, les contenus synthétiques doivent être étiquetés comme tels.