Taalas : graver son modèle d'IA directement dans une puce

Dans le monde de l'IA, on a l'habitude de séparer le logiciel du matériel. On entraîne un modèle, on le déploie sur des GPU ou des TPU, et on l'exécute. La startup canadienne Taalas bouscule cette logique avec une idée radicale : transformer le modèle lui-même en puce électronique. Fini le logiciel, place au « durci ». J'ai creusé cette technologie pour comprendre ce qu'elle change vraiment.

Le concept : le modèle est l'ordinateur

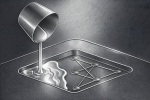

Le slogan de Taalas est clair : « The Model is The Computer ». En français : le modèle est l'ordinateur. Concrètement, l'entreprise a développé une plateforme capable de prendre n'importe quel modèle d'IA entraîné et de le convertir en un circuit intégré dédié. Les poids du modèle, ces paramètres numériques qui définissent son « intelligence », ne sont plus stockés dans une mémoire vive. Ils sont gravés physiquement dans la structure même de la puce.

Cela signifie que le modèle n'est plus « exécuté » par un processeur. Il est le processeur. Une fois la puce fabriquée, elle ne sait faire qu'une chose : faire tourner ce modèle précis, de manière ultra-efficace. C'est une approche qu'on pourrait qualifier de « monofonction » mais extrêmement optimisée.

Une technologie hybride : ROM et SRAM

Pour rendre cela possible, Taalas utilise une architecture hybride ingénieuse. La majeure partie des poids du modèle est stockée dans une mémoire morte (ROM), gravée lors de la fabrication. C'est ce qui rend le modèle permanent. À côté, on trouve une quantité importante de mémoire vive rapide (SRAM), utilisée pour le contexte, les caches et les éventuels ajustements fins. Cette combinaison permet d'obtenir à la fois la densité de la ROM et la flexibilité de la SRAM.

Des performances annoncées très élevées

Sur le papier, les chiffres avancés sont impressionnants. Le premier produit de Taalas, la puce HC1, intègre le modèle Llama 3.1 8B de Meta. Selon l'entreprise, elle atteindrait des débits de l'ordre de 16 000 tokens par seconde en inférence. Pour donner un ordre d'idée, c'est largement supérieur aux solutions actuelles basées sur des GPU comme le H200 de Nvidia, qui tourne autour de quelques milliers de tokens par seconde pour le même modèle.

Cette performance s'accompagne d'une latence très faible, ce qui est crucial pour des applications interactives comme les agents conversationnels. L'entreprise attribue ces gains à l'élimination du goulot d'étranglement classique : le déplacement des données entre la mémoire et le processeur. Ici, tout est intégré.

Ce que dit l'analyse externe

Il est important de garder du recul. La plupart des benchmarks proviennent pour l'instant de Taalas elle-même. Des analyses techniques détaillées, comme celle du site The Next Platform, confirment la validité de l'approche théorique mais soulignent qu'il n'existe pas encore de tests indépendants complets. L'architecture est solide sur le papier, mais la validation à grande échelle par des tiers reste à faire.

Comment ça marche : de la théorie à la puce

Le processus de fabrication, appelé « flot de production », est un point clé de la proposition de valeur. Taalas a conçu un système pour que la création d'une puce dédiée à un nouveau modèle soit rapide et économique. La puce de base est conçue comme un « semi-produit ». Elle contient la majeure partie de la logique, mais les dernières couches de métallisation, celles qui définissent les connexions finales, sont personnalisées en fonction du modèle.

Cela signifie que pour « graver » un nouveau modèle, il n'est pas nécessaire de repartir de zéro. On modifie seulement deux couches de masques sur une tranche de silicium déjà en grande partie fabriquée. Le passage d'un modèle à un autre pourrait ainsi se faire en quelques semaines, là où la conception d'une puce classique prend des années.

Mon avis : une approche radicale et logique

Cette approche me fascine par sa logique implacable. On pousse le principe de spécialisation à son paroxysme. Les GPU sont devenus la norme pour l'IA car ils sont massivement parallèles. Mais ils restent des généralistes, conçus à la base pour le graphisme. Taalas propose une spécialisation totale : une puce pour UN modèle.

C'est un pari audacieux. D'un côté, on gagne en efficacité pure. De l'autre, on perd toute flexibilité. Imaginez : une puce ne sait faire que tourner Llama 3.1 8B. Si Meta sort Llama 3.2, il faut une nouvelle puce. C'est un modèle qui s'éloigne de l'universalité du logiciel pour aller vers une forme de matérialisation de l'intelligence.

Pour qui c'est fait ?

Je vois deux cas d'usage principaux. D'abord, les entreprises qui déploient un modèle spécifique à très grande échelle, comme un assistant vocal ou un système de recommandation. L'investissement initial est rentabilisé par des coûts d'inférence drastiquement réduits sur le long terme. Ensuite, les applications critiques où la latence et la consommation énergétique sont cruciales, comme dans la robotique ou l'automobile.

Les défis à surmonter

Cette technologie n'est pas sans obstacles. Le premier est économique : fabriquer des puces coûte cher, même avec l'optimisation de Taalas. Il faut un volume suffisant pour amortir les coûts. Le second est lié à l'évolution rapide des modèles. L'IA progresse à une vitesse folle. Une puce gravée pour un modèle risque d'être obsolète en quelques mois.

Un troisième défi, plus technique, concerne la flexibilité. Si les poids sont gravés, comment effectuer des ajustements (fine-tuning) ? Taalas prévoit de la mémoire SRAM pour des adaptations mineures, mais cela reste plus limité qu'un modèle logiciel classique.

Une concurrence qui s'organise

Taalas n'est pas seul sur ce créneau. D'autres acteurs comme Groq (racheté par Nvidia), Cerebras ou SambaNova travaillent sur des architectures spécialisées pour l'inférence. Cependant, Taalas se distingue par son approche de gravure directe des modèles. C'est une différence de degré, pas de nature, mais elle est significative.

L'entreprise a déjà levé plus de 200 millions de dollars et compte parmi ses investisseurs des pointures du monde des semi-conducteurs. C'est un signe fort qui montre que l'idée est prise au sérieux.

Sources

- Site officiel de Taalas : Présentation de la plateforme et de la philosophie « The Model is The Computer ».

- Article de The Next Platform : Analyse technique détaillée de l'architecture et des performances.

- Article de Reuters : Information sur la levée de fonds et le positionnement face à Nvidia.

- Article de Forbes : Analyse des performances et du potentiel de marché.

Qu'est-ce que Taalas propose exactement ?

Taalas propose une technologie pour transformer un modèle d'IA entraîné en une puce électronique dédiée. Les poids du modèle sont gravés physiquement dans le silicium, ce qui rend le modèle permanent et extrêmement efficace pour l'inférence.

Quels sont les avantages de graver un modèle d'IA dans une puce ?

Les principaux avantages sont une vitesse d'inférence très élevée (jusqu'à 16 000 tokens/seconde pour Llama 3.1 8B), une latence faible et une meilleure efficacité énergétique. Cela élimine le goulot d'étranglement entre la mémoire et le processeur.

Peut-on modifier un modèle d'IA une fois gravé dans une puce ?

Les modifications sont limitées. La puce contient de la mémoire SRAM pour des ajustements mineurs (fine-tuning léger), mais les poids principaux sont gravés de manière permanente dans la mémoire ROM. Pour un nouveau modèle, il faut fabriquer une nouvelle puce.

Combien coûte une puce Taalas ?

Le coût exact n'est pas public. La fabrication de puces reste onéreuse, mais Taalas optimise le processus en ne personnalisant que les dernières couches de métallisation. Le modèle économique vise un retour sur investissement par des économies sur les coûts d'inférence à grande échelle.